chat - Hello World

2025年11月18日 下午9:09:53

1、部署本地大语言模型(llm)

借用 ollama 部署 llama3.2 模式(这个比较小,1G大小左右)

ollama run llama3.2 # 或 deepseek-r1:7b

具体可参考:ollama 部署本地环境

2、开始新建项目(通过 solon-ai 使用 llm)

可以用 Solon Initializr 生成一个模板项目。新建项目之后,添加依赖:

<dependency>

<groupId>org.noear</groupId>

<artifactId>solon-ai</artifactId>

</dependency>

3、添加应用配置

在 app.yml 应用配置文件里,添加如下内容:

solon.ai.chat:

demo:

apiUrl: "http://127.0.0.1:11434/api/chat" # 使用完整地址(而不是 api_base)

provider: "ollama" # 使用 ollama 服务时,需要配置 provider

model: "llama3.2" # 或 deepseek-r1:7b

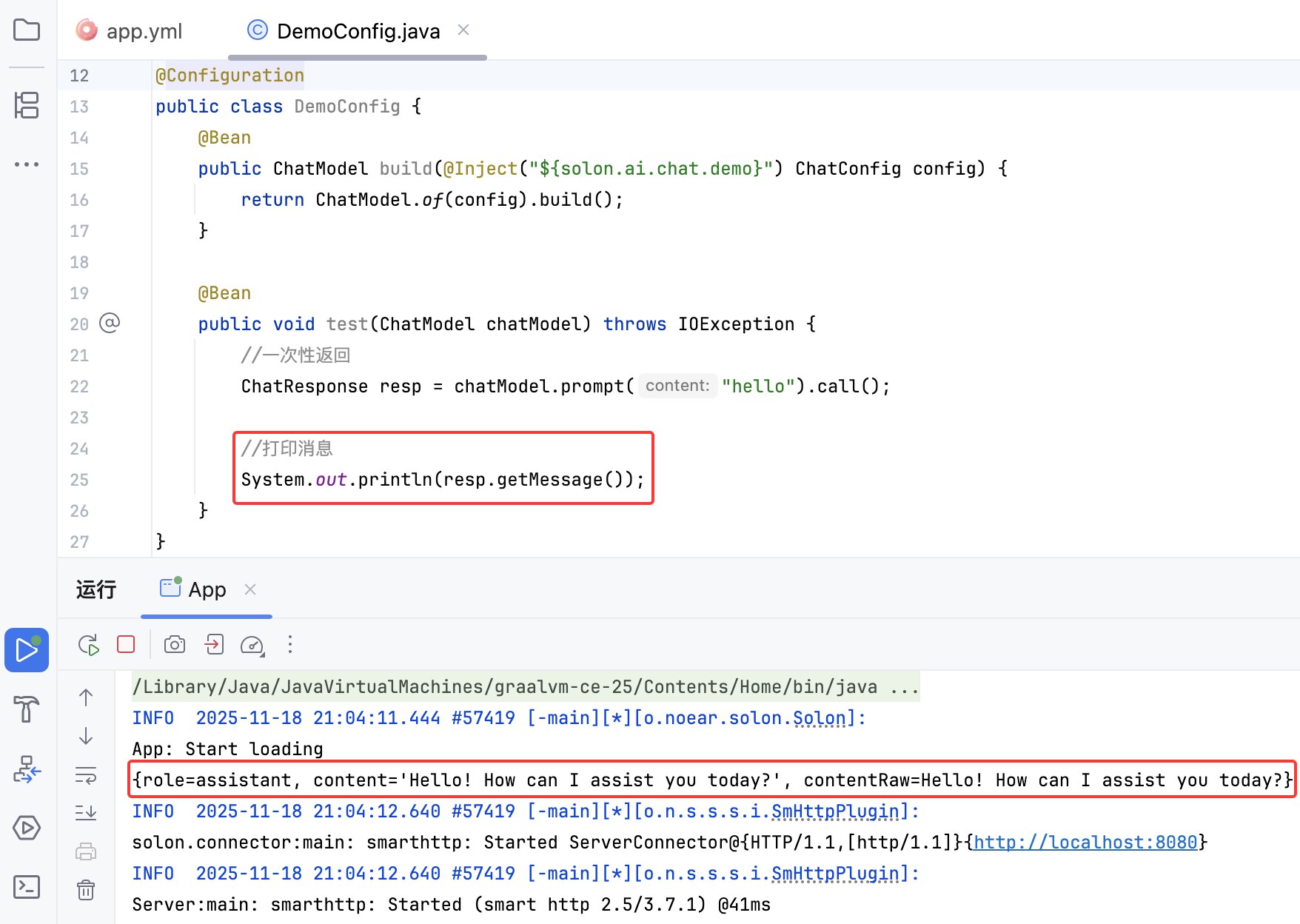

4、添加配置类和测试代码

在项目里,添加一个 DemoConfig。概构建 ChatModel,也做测试。

import org.noear.solon.ai.chat.ChatConfig;

import org.noear.solon.ai.chat.ChatModel;

import org.noear.solon.ai.chat.ChatResponse;

import org.noear.solon.annotation.Bean;

import org.noear.solon.annotation.Configuration;

import org.noear.solon.annotation.Inject;

import java.io.IOException;

@Configuration

public class DemoConfig {

@Bean

public ChatModel build(@Inject("${solon.ai.chat.demo}") ChatConfig config) {

return ChatModel.of(config).build();

}

@Bean

public void test(ChatModel chatModel) throws IOException {

//一次性返回

ChatResponse resp = chatModel.prompt("hello").call();

//打印消息

System.out.println(resp.getMessage());

}

}

5、程序启动后